Maschinelles Lernen

Maschinelles Lernen beschäftigt sich mit der Generierung von Wissen aus Erfahrung und stellt eine Schlüsseltechnologie für moderne Methoden der künstlichen Intelligenz dar.

Mit Hilfe komplexer statistischer Modelle sollen Ergebnisse, die durch bereits bekannte Trainingsdaten gelernt wurden, auf unbekannte neue Daten verallgemeinert werden. Es entsteht ein selbstlernendes Computerprogramm. Interessant und herausfordernd sind sowohl der Fall, wenn mit sehr großen Datenmengen gearbeitet wird, als auch der Fall, wenn nur wenige Daten zur Verfügung stehen.

Forschungsthema: Hyperparameter-Optimierung

Häufig werden Regularisierungsterme beim Lernen guter Modelle verwendet. Solche Terme können bestimmte Lösungsstrukturen (bspw. Sparsity, Low-Rank) erzeugen und die Überanpassung an die Trainingsdaten (Overfitting) verhindern. Die Gewichtung dieser zusätzlichen Kriterien erfolgt durch sogenannte Regularisierungsparameter. Die passende Wahl dieser zusätzlichen Hyperparameter ist dabei sehr wichtig für den Erhalt eines brauchbaren Modells mit hoher Vorhersagegüte.

In den Publikationen Using Benson's Algorithm for Regularization Parameter Tracking und Efficient Regularization Parameter Selection for Latent Variable Graphical Models via Bi-Level Optimization verwenden wir den Benson-Algorithmus aus der Vektoroptimierung zur Wahl der Hyperparameter und vergleichen dieses Verfahren mit den häufig genutzen Methoden Manual Search, Grid Search und Random Search.

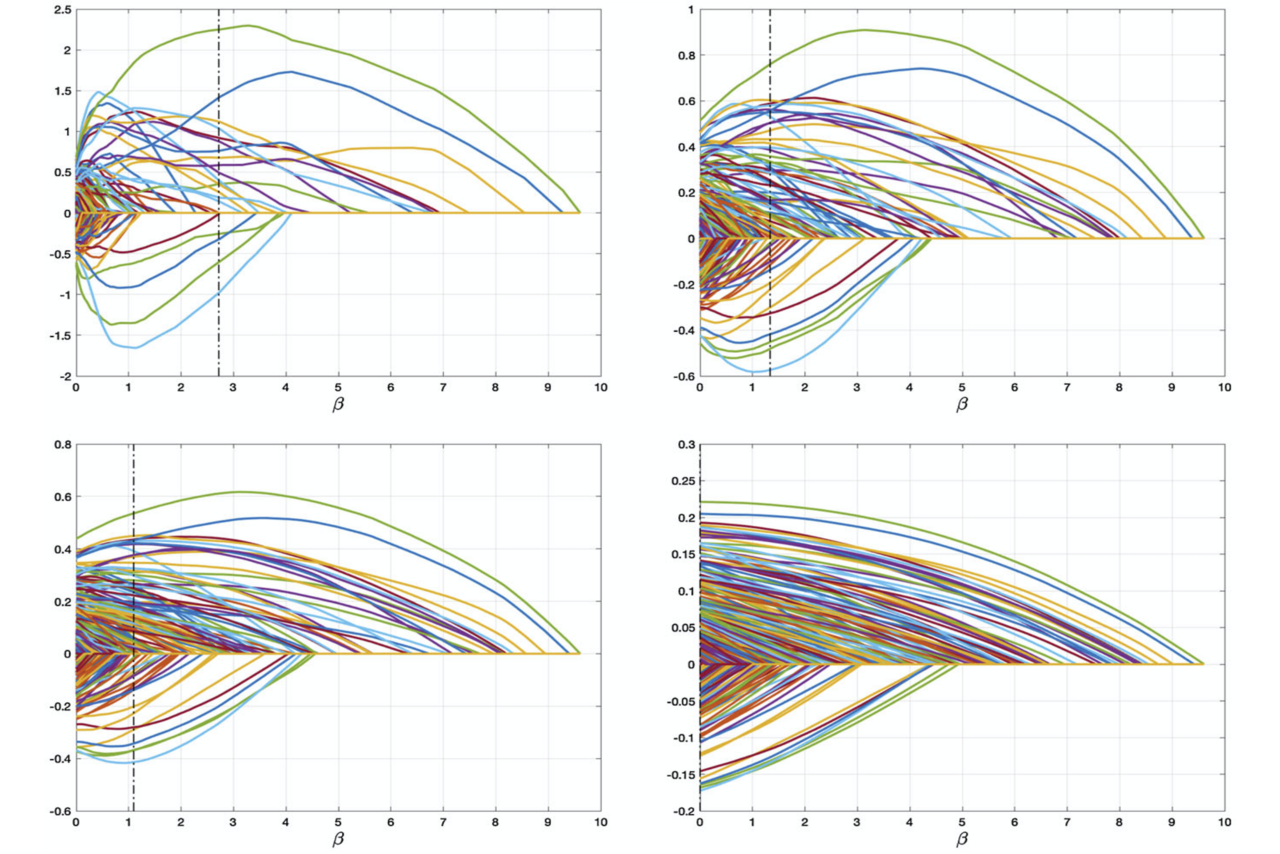

Die folgende Abbildung zeigt mehrere sogenannte Regularisierungspfade für einen Lungenkrebs-Datensatz. Die gestrichelte Linie markiert jeweils die Parameterwahl für das Modell mit den besten Vorhersagen. Eine ausführlichere Erklärung zu dieser Aufgabenstellung befindet sich im folgenden Beitrag bei der EAH-Hochschulzeitung "Facetten"

D. Dörfler, A. Löhne, Ch. Schneider und B. Weißing (2022)

A Benson-Type Algorithm for Bounded Convex Vector Optimization Problems with Vertex Selection

Optimization Methods and Software 37(3), S. 1006–1026

https://doi.org/10.1080/10556788.2021.1880579

H. Bonnel und Ch. Schneider (2019)

Post-Pareto Analysis and a New Algorithm for the Optimal Parameter Tuning of the Elastic Net

Journal of Optimization Theory and Applications 183, S. 993–1027

https://doi.org/10.1007/s10957-019-01592-x

J. Giesen, F. Nussbaum und Ch. Schneider (2019)

Efficient Regularization Parameter Selection for Latent Variable Graphical Models via Bi-Level Optimization

Proceedings of the 28th International Joint Conference on Artificial Intelligence (IJCAI), S. 2378–2384

https://doi.org/10.24963/ijcai.2019/330

J. Giesen, S. Laue, A. Löhne und Ch. Schneider (2019)

Using Benson's Algorithm for Regularization Parameter Tracking

Proceedings of the 33d AAAI Conference on Artificial Intelligence (AAAI), S. 3689–3696

https://doi.org/10.1609/aaai.v33i01.33013689